分享一个能让头像图片模仿目标视频动起来的方法

首先说一下这个模型的原理:

这个模型使用一种叫做”hin-plate spline”的方法来估计一个更灵活的”光流,它可以将源图像的特征图变形到驱动视频的特征域。然后,它利用多分辨率的“遮挡掩码”来实现更有效的特征融合,从而恢复缺失的区域。最后,它设计了一此额外的辅助损生函数来确保网络各人模块有明确的分工,促使网终生成高质量的图像。

简单来说,这入模型就是通过学习源图像天驱动视频之间的运动关系,来生成一个与源图像相似但具有驱动视频中运动的动画效果。

教程:

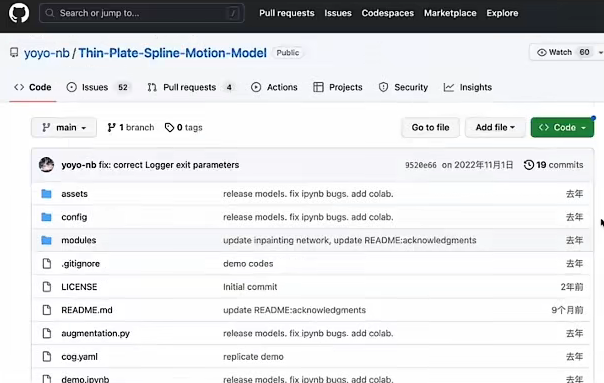

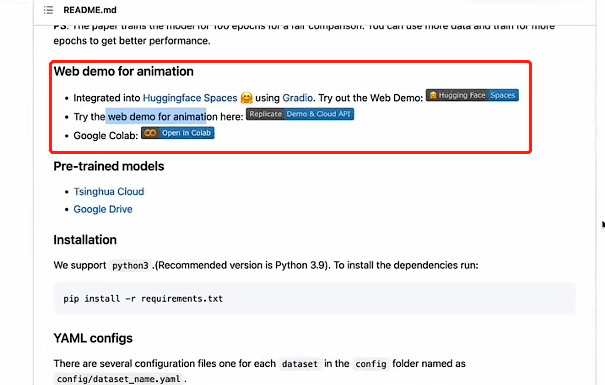

首先,在github上找到这个模型:

yoyo-nb/Thin-Plate-Spline-Motion-Model,这个模型是发布于2022年。

然后找到这个Web demo for animation的地址:

1、 Hugging Face拥抱脸——简单,比较慢

2、 API: Replicate——Demo&Cloud API——简单,容易上手,比较推荐使用

3、 Open in Colab——开源代码: Google colab,集成了扩大视频清晰度的一个模型

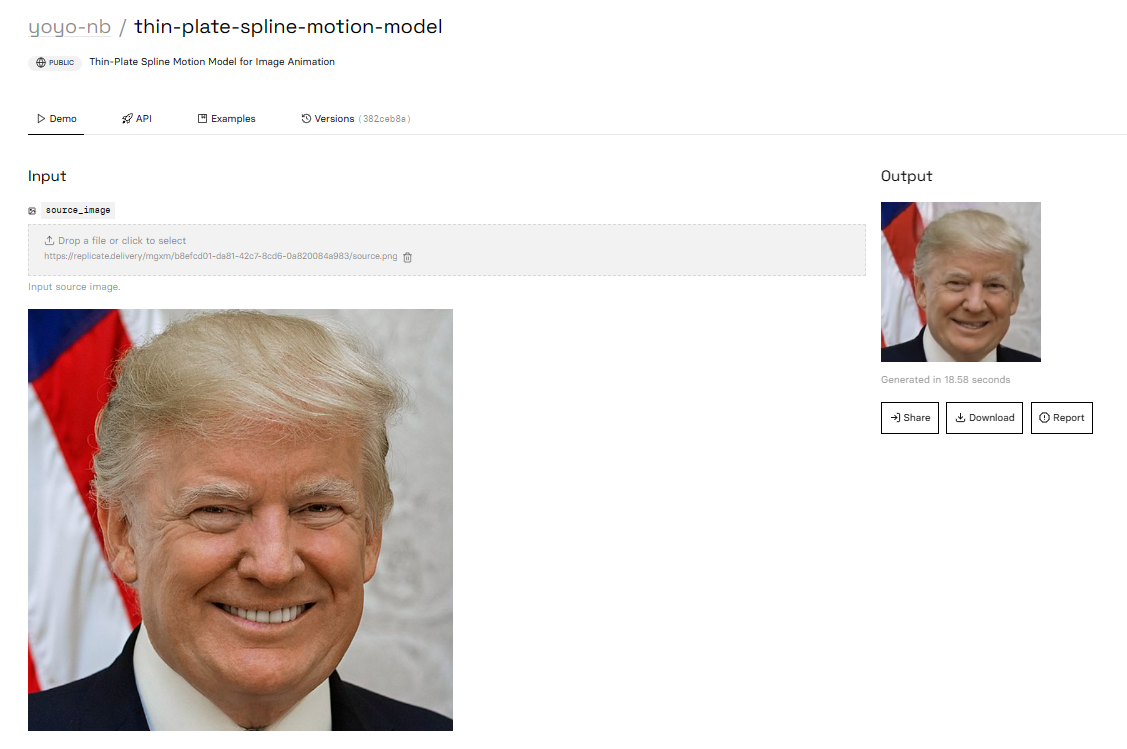

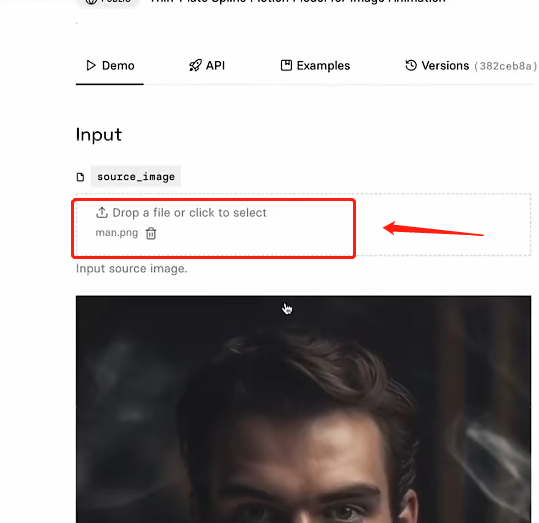

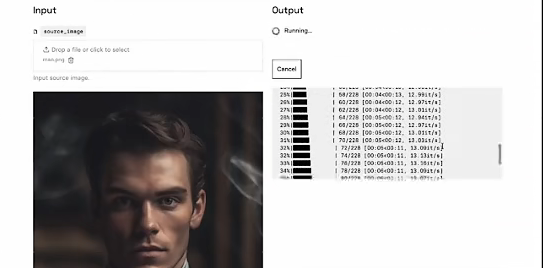

我们这里用replicate做个演示

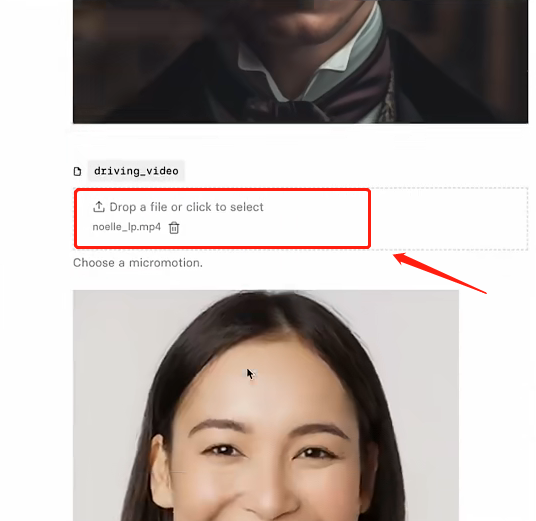

在输入的部分上传你的图片以及视频动作。

在输入的部分上传你的图片以及视频动作。

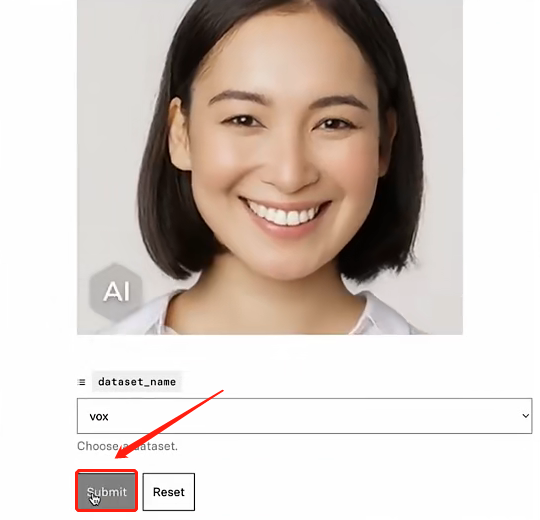

然后点击提交。

然后点击提交。 很快就可以生成了。

很快就可以生成了。

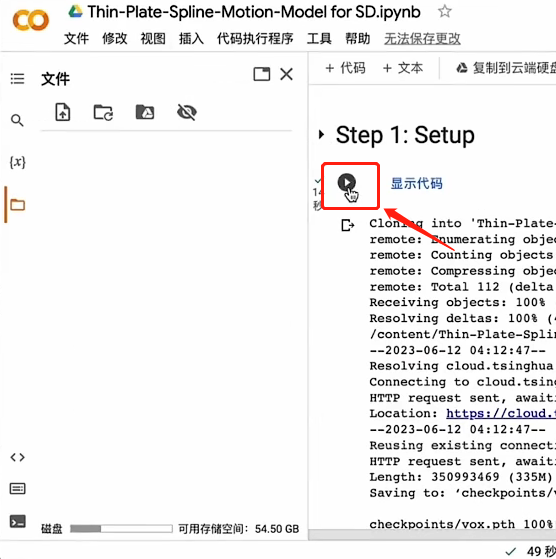

如果你想要更高清的视频,推荐使用 Google colab 的链接。

点击线上执行代码就可以了。

请关注公众号:AI超级智库

公众号将作为AIGC超级智库的官网入口,发布行业最新学习资料、资讯,请一定要关注

社群

进入AIGC交流学习群,大家一起交流学习,希望大家共同努力,维护高质量交流社群!请加微信,然后再拉你进群!

同时请遵守群规,营造一个好的学习环境,严禁广告、引流、政治、TZ等敏感话题,必飞机✈️

京公网安备 11010802039477号

京公网安备 11010802039477号